Historia del estudio Framingham (I)

Ahora que ya he cumplido todas mis promesas sobre artículos pendientes (salvo FODMAPs, pero esa promesa me la hice a mi, así que no cuenta :-P) voy a cambiar un poco el tono del blog. Hoy vamos a hablar de historia.

Si recordáis, en mi artículo sobre los análisis de colesterol, citaba el estudio Framingham. Pues hoy os voy a hablar un poco sobre cómo empezó el estudio, cómo se mantiene, y cómo evoluciona en el tiempo.

Lo primero de todo es decir que el estudio Framingham se hizo en la ciudad de Framingham (¡qué coincidencia!) en el estado de Massachusetts (tres veces he tenido que comprobar que lo he escrito bien; y aún así no me quedo tranquilo). Esto quiere decir que la población que se usa en el estudio es norteamericana con una proporción alta de blancos anglosajones de clase media.

Por lo tanto, los valores de estimaciones son válidos para ese tipo de población y no otra. Por ejemplo, para los europeos, los modelos sobreestiman el riesgo cardiovascular, y esa es la razón de que aquí se usen otros modelos estadísticos, como REGICOR o SCORE (habrá otro artículo sobre esto). Los motivos de esta sobreestimación pueden deberse a factores medioambientales, o a la distinta alimentación, por ejemplo.

No obstante, los responsables del estudio dicen que en controles realizados por otros investigadores, se comprueba que -más o menos- los valores son extrapolables al resto de población mundial. Al fin y al cabo todos somos de la misma especie y compartimos mas del 99% del genoma.

El estudio comenzó en 1948, cuando se reclutaron 5.209 hombres y mujeres entre 30 y 62 años para realizarles análisis de salud y hacer seguimiento de sus historias de enfermedad cardiovascular.

Hay que decir que uno de los problemas del estudio es que los 5.209 sujetos fueron voluntarios, y no aleatorizados. Además, se eligió la ciudad de Framingham por conveniencia, al ser de un tamaño acorde al estudio y disponer de centros de salud estratégicamente ubicados. Los autores reconocen que no es la mejor forma de hacer un estudio, pero está claro que entre nada y esto, nos quedamos con esto.

Cada dos años los sujetos volvían a consulta para un nuevo examen y en 1971, se incorporó la segunda generación de participantes, hijos y mujeres de los primeros, en un total de 5.124. Posteriormente, en 1994 se decidió que la composición de los participantes no reflejaba la población real y se añadio otra cohorte al estudio. Además, se añadieron más cohortes en 2002 y 2003.

Actualmente se están registrando marcadores de más tipos, como por ejemplo genéticos, con la idea de estudiar como se comportan las enfermedades a lo largo de varias generaciones, y en función de la genetica y las condiciones ambientales (que también cambian, no pensemos que no).

Como dije en el artículo anterior de los análisis, el estudio monitoriza el valor de ciertas variables escogidas por los investigadores a priori. Estas variables no son fijas, han ido cambiando con el tiempo a medida que se descubrían nuevas relaciones entre enfermedad cardiovascular y nuevos marcadores. Sin embargo, tenemos que ser conscientes de que si una variable no se incluye en el estudio, es imposible evaluar el riesgo cardiovascular en base a ella.

Esto sería especialmente dramático si pasase algo parecido a lo siguiente: imaginemos que se descubre la causa real de enfermedad cardiovascular y que solo es una. Por poner un ejemplo ficticio, supongamos que se descubre que la enfermedad cardiovascular es directamente proporcional al consumo de una nueva molécula -que han descubierto en los alimentos- llamada raticulina: a más raticulina ingerida al día, más riesgo.

En ese caso podríamos evaluar el riesgo cardiovascular de dos maneras: con el Framingham o analizando el consumo de raticulina. ¿Qué sería lo lógico? Para empezar elegir los valores obtenidos con el consumo de raticulina, que sabemos que son más fiables, y pasar de los del Framingham.

Pero es que además podríamos coger 10.000 sujetos, medir sus niveles mediante Framingham y el test de la raticulina y ver como ajustan. Y aquí vendría lo dramático. ¿Qué pasaría si los valores se pareciesen como un huevo a una castaña? Pues que habríamos estado la friolera de 63 años estimando el riesgo cardiovascular con unos modelos incorrectos, con lo que esto conlleva y con la afectación de vidas de miles de personas.

¿Cómo sabemos que no estamos haciendo el canelo usando el Framingham os preguntaréis? Pues bueno, porque para eso se hacen otros estudios de control, y se está constantemente poniendo a prueba el modelo. Esto da lugar a resultados donde se demuestra que el modelo no es perfecto, que se pueden incluir nuevas variables, que se pueden quitar otras, etc. Por eso se añadió más gente al estudio y se retocaron variables. Sin embargo, y a pesar de la constante imperfección del modelo, el estudio es muchísimo mejor que no tener nada y no tiene sentido despreciarlo a la ligera.

Lo que quiero poner de manifiesto es que, cuando leáis un análisis de sangre por ejemplo, no basta con ver si salen asteriscos porque los valores están fuera del rango de normalidad, sino que tenéis que analizar esos valores con ayuda de vuestro médico. A la inversa, no os penséis que porque no salgan asteriscos estáis perfectos, porque igual que hay falsos positivos, hay falsos negativos.

Además, daos cuenta de que la normalidad es lo que más abunda, pero no tiene por qué ser necesariamente lo mejor. Por ejemplo, en una población donde nadie ingiere hierro, todos estarán anémicos, y lo normal será estar anémico. Pero eso no quiere decir que por estar anémicos estemos sanos.

Para terminar este apartado, os recomiendo consultar -si no lo habéis hecho ya- la diferencia entre correlación y causalidad dado que todos estos problemas suceden porque el Framingham, al ser un estudio observacional de cohortes es, por diseño, correlativo y no causal, y por lo tanto es una herramienta más válida para ayudar en el análisis de nuestro estado de salud que para adivinar el futuro de una forma infalible (como algunos creen o nos quieren hacer creer).

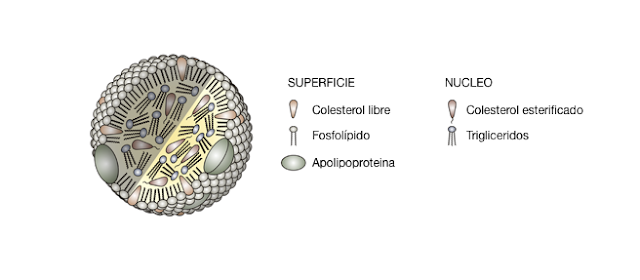

Veamos ahora que marcadores se han ido relacionado con el riesgo cardiovascular en el estudio Framingham. Los principales son: tensión (presión sanguínea) alta, altos niveles de lipoproteina (colésterol), bajos niveles de lipoproteína HDL (el colesterol bueno), fumar, obesidad, diabetes e inactividad fisica. Esto quiere decir que, a grandes rasgos, la hipótesis es que si mantenemos estos valores controlados nos podemos considerar sanos.

Fijaos que hay dos tipos de marcador: los númericos (como el colesterol) y los de sí/no (como fumar). Esto tiene varias implicaciones:

Es también interesante darse cuenta de una incoherencia importante: aunque se cita la actividad física como relacionada con el riesgo cardiovascular luego no se tiene en cuenta en las ecuaciones de cálculo de riesgo cardiovascular. Es decir, los autores reconocen que influye pero nadie la tiene en cuenta en el modelo estadístico.

Esto puede ser por tres razones: falta de datos fiables, dejadez, o porque se determine que la actividad física es la causa directa de otra variable (por ejemplo, sería el caso si siempre se cumpliera que a más actividad, más colesterol HDL).

Si me preguntáis yo espero que la causa sea la primera (falta de datos) pero tengo que reconocer que no he investigado el por qué de esta decisión. Si alguno lo sabéis por favor dejadlo en los comentarios :-).

Vale, ya tenemos el estudio y ya tenemos el modelo estadístico ¿Qué hacemos ahora con él? Pues lo que hice yo en el artículo anterior: meter los valores en la fórmula y ver qué riesgo predice ¿Y una vez tenemos el riesgo? Una vez tenemos el riesgo la cosa se vuelve a complicar porque... ¿A partir de qué valor el riesgo es alto? ¿5%? ¿10%? ¿50%? Ese es el meollo de la cuestión, y ese el parámetro que se está cambiando constantemente a la baja (probablemente bajo cierta presión de las farmacéuticas).

Si os fijáis, la determinación del valor de intervención (riesgo a partir del cual pensamos que es mejor medicar) es algo totalmente subjetivo. Idealmente deberíamos reducir lo máximo posible el nivel de riesgo de la población sin causar más estragos de los que estamos solucionando. Pero ahí esta la trampa porque, por ejemplo, las estatinas mejoran el riesgo pero pueden causar dolores musculares o incluso diabetes tipo II, entonces, ¿qué es mejor? ¿Prolongar la vida de un sujeto -digamos- 5 años o causar a otro sujeto diabetes II? La respuesta varía dependiendo de a quién preguntes.

Lamentablemente no se está haciendo así, y además los niveles de corte se bajan cada vez más porque, cuanto más se bajen, más población "se salva". Pero ¡ojo!, esto es solo teóricamente, porque habría que volver a demostrarlo con nuevos estudios. Es decir, si yo tengo el nivel de corte en 240 y se salvan 10 y veo que bajando a 200 se salvan 20, esto es solo una inferencia teórica, porque estoy asumiendo que a la gente nueva que voy a tratar (los que están entre 200 y 240) les va a funcionar igual de bien el tratamiento que a los que tienen ahora más de 240. Pero eso hay que demostrarlo con más estudios, porque puede no ser así.

Con estas reflexiones termino. En el próximo artículo profundizaremos más en la historia del Framingham y en posteriores hablaremos de las adaptaciones que se han hecho de este estudio para población europea.

No olviden vitaminarse y supermineralizarse.

Si recordáis, en mi artículo sobre los análisis de colesterol, citaba el estudio Framingham. Pues hoy os voy a hablar un poco sobre cómo empezó el estudio, cómo se mantiene, y cómo evoluciona en el tiempo.

Población

Lo primero de todo es decir que el estudio Framingham se hizo en la ciudad de Framingham (¡qué coincidencia!) en el estado de Massachusetts (tres veces he tenido que comprobar que lo he escrito bien; y aún así no me quedo tranquilo). Esto quiere decir que la población que se usa en el estudio es norteamericana con una proporción alta de blancos anglosajones de clase media.

Por lo tanto, los valores de estimaciones son válidos para ese tipo de población y no otra. Por ejemplo, para los europeos, los modelos sobreestiman el riesgo cardiovascular, y esa es la razón de que aquí se usen otros modelos estadísticos, como REGICOR o SCORE (habrá otro artículo sobre esto). Los motivos de esta sobreestimación pueden deberse a factores medioambientales, o a la distinta alimentación, por ejemplo.

No obstante, los responsables del estudio dicen que en controles realizados por otros investigadores, se comprueba que -más o menos- los valores son extrapolables al resto de población mundial. Al fin y al cabo todos somos de la misma especie y compartimos mas del 99% del genoma.

Desarrollo del estudio

El estudio comenzó en 1948, cuando se reclutaron 5.209 hombres y mujeres entre 30 y 62 años para realizarles análisis de salud y hacer seguimiento de sus historias de enfermedad cardiovascular.

Hay que decir que uno de los problemas del estudio es que los 5.209 sujetos fueron voluntarios, y no aleatorizados. Además, se eligió la ciudad de Framingham por conveniencia, al ser de un tamaño acorde al estudio y disponer de centros de salud estratégicamente ubicados. Los autores reconocen que no es la mejor forma de hacer un estudio, pero está claro que entre nada y esto, nos quedamos con esto.

Cada dos años los sujetos volvían a consulta para un nuevo examen y en 1971, se incorporó la segunda generación de participantes, hijos y mujeres de los primeros, en un total de 5.124. Posteriormente, en 1994 se decidió que la composición de los participantes no reflejaba la población real y se añadio otra cohorte al estudio. Además, se añadieron más cohortes en 2002 y 2003.

Actualmente se están registrando marcadores de más tipos, como por ejemplo genéticos, con la idea de estudiar como se comportan las enfermedades a lo largo de varias generaciones, y en función de la genetica y las condiciones ambientales (que también cambian, no pensemos que no).

Determinación de los marcadores

Como dije en el artículo anterior de los análisis, el estudio monitoriza el valor de ciertas variables escogidas por los investigadores a priori. Estas variables no son fijas, han ido cambiando con el tiempo a medida que se descubrían nuevas relaciones entre enfermedad cardiovascular y nuevos marcadores. Sin embargo, tenemos que ser conscientes de que si una variable no se incluye en el estudio, es imposible evaluar el riesgo cardiovascular en base a ella.

Esto sería especialmente dramático si pasase algo parecido a lo siguiente: imaginemos que se descubre la causa real de enfermedad cardiovascular y que solo es una. Por poner un ejemplo ficticio, supongamos que se descubre que la enfermedad cardiovascular es directamente proporcional al consumo de una nueva molécula -que han descubierto en los alimentos- llamada raticulina: a más raticulina ingerida al día, más riesgo.

En ese caso podríamos evaluar el riesgo cardiovascular de dos maneras: con el Framingham o analizando el consumo de raticulina. ¿Qué sería lo lógico? Para empezar elegir los valores obtenidos con el consumo de raticulina, que sabemos que son más fiables, y pasar de los del Framingham.

Pero es que además podríamos coger 10.000 sujetos, medir sus niveles mediante Framingham y el test de la raticulina y ver como ajustan. Y aquí vendría lo dramático. ¿Qué pasaría si los valores se pareciesen como un huevo a una castaña? Pues que habríamos estado la friolera de 63 años estimando el riesgo cardiovascular con unos modelos incorrectos, con lo que esto conlleva y con la afectación de vidas de miles de personas.

¡Pensadlo!

¿Ya lo habéis pensado?

Pensadlo otra vez

No me digáis que no os inquieta...

¿Cómo sabemos que no estamos haciendo el canelo usando el Framingham os preguntaréis? Pues bueno, porque para eso se hacen otros estudios de control, y se está constantemente poniendo a prueba el modelo. Esto da lugar a resultados donde se demuestra que el modelo no es perfecto, que se pueden incluir nuevas variables, que se pueden quitar otras, etc. Por eso se añadió más gente al estudio y se retocaron variables. Sin embargo, y a pesar de la constante imperfección del modelo, el estudio es muchísimo mejor que no tener nada y no tiene sentido despreciarlo a la ligera.

Lo que quiero poner de manifiesto es que, cuando leáis un análisis de sangre por ejemplo, no basta con ver si salen asteriscos porque los valores están fuera del rango de normalidad, sino que tenéis que analizar esos valores con ayuda de vuestro médico. A la inversa, no os penséis que porque no salgan asteriscos estáis perfectos, porque igual que hay falsos positivos, hay falsos negativos.

Además, daos cuenta de que la normalidad es lo que más abunda, pero no tiene por qué ser necesariamente lo mejor. Por ejemplo, en una población donde nadie ingiere hierro, todos estarán anémicos, y lo normal será estar anémico. Pero eso no quiere decir que por estar anémicos estemos sanos.

Para terminar este apartado, os recomiendo consultar -si no lo habéis hecho ya- la diferencia entre correlación y causalidad dado que todos estos problemas suceden porque el Framingham, al ser un estudio observacional de cohortes es, por diseño, correlativo y no causal, y por lo tanto es una herramienta más válida para ayudar en el análisis de nuestro estado de salud que para adivinar el futuro de una forma infalible (como algunos creen o nos quieren hacer creer).

Marcadores de riesgo cardiovascular

Veamos ahora que marcadores se han ido relacionado con el riesgo cardiovascular en el estudio Framingham. Los principales son: tensión (presión sanguínea) alta, altos niveles de lipoproteina (colésterol), bajos niveles de lipoproteína HDL (el colesterol bueno), fumar, obesidad, diabetes e inactividad fisica. Esto quiere decir que, a grandes rasgos, la hipótesis es que si mantenemos estos valores controlados nos podemos considerar sanos.

Fijaos que hay dos tipos de marcador: los númericos (como el colesterol) y los de sí/no (como fumar). Esto tiene varias implicaciones:

- Los numéricos permiten realizar estimaciones más precisas porque relacionan un valor de colesterol por ejemplo, con un riesgo cardiovascular. Por ejemplo: imaginemos que el riesgo es exactamente igual al valor de colesterol dividido entre 10.000. Si tenemos un colesterol de 200, el riesgo predicho sera de un 2%, mientras que si el colesterol es 300, tendremos un riesgo del 3%.

- Los de sí/no dan menos de si. Por ejemplo: podemos decir que si fumas el riesgo medio es de un 20% y si no, de un 3%. Pero no podemos decir más porque o fumas, o no fumas, pero no hay mas entradas posibles.

- Los de sí/no no discriminan entre dosis. Por ejemplo: ¿qué es inactividad física? ¿Cuándo somos sedentarios y cuándo no? ¿Es lo mismo hacer media hora de ciclismo cuatro veces por semana que ocho? Hay que poner un punto de corte para partir a la población en dos grupos. Y obviamente los que estén cerca del punto de corte obtendrán valores más imperfectos.

- Por ultimo, hay varios marcadores y al final los modelos estadísticos relacionan todos entre si. Pero puede que dos marcadores entren en contradicción y uno sea más imperfecto que el otro. En el ejemplo inventado de la raticulina sabemos que el análisis bueno es el de la raticulina, pero podríamos simplemente haber añadido la raticulina al Framingham (en lugar de tirar el Framingham y usar en su lugar la raticulina), con lo que hubiésemos distorsionado los valores a peor porque tendríamos el valor perfecto (la raticulina) y un montón de ruido alrededor (las demás variables antiguas del Framingham).

Es también interesante darse cuenta de una incoherencia importante: aunque se cita la actividad física como relacionada con el riesgo cardiovascular luego no se tiene en cuenta en las ecuaciones de cálculo de riesgo cardiovascular. Es decir, los autores reconocen que influye pero nadie la tiene en cuenta en el modelo estadístico.

Esto puede ser por tres razones: falta de datos fiables, dejadez, o porque se determine que la actividad física es la causa directa de otra variable (por ejemplo, sería el caso si siempre se cumpliera que a más actividad, más colesterol HDL).

Si me preguntáis yo espero que la causa sea la primera (falta de datos) pero tengo que reconocer que no he investigado el por qué de esta decisión. Si alguno lo sabéis por favor dejadlo en los comentarios :-).

Interpretación del riesgo cardiovascular

Vale, ya tenemos el estudio y ya tenemos el modelo estadístico ¿Qué hacemos ahora con él? Pues lo que hice yo en el artículo anterior: meter los valores en la fórmula y ver qué riesgo predice ¿Y una vez tenemos el riesgo? Una vez tenemos el riesgo la cosa se vuelve a complicar porque... ¿A partir de qué valor el riesgo es alto? ¿5%? ¿10%? ¿50%? Ese es el meollo de la cuestión, y ese el parámetro que se está cambiando constantemente a la baja (probablemente bajo cierta presión de las farmacéuticas).

Si os fijáis, la determinación del valor de intervención (riesgo a partir del cual pensamos que es mejor medicar) es algo totalmente subjetivo. Idealmente deberíamos reducir lo máximo posible el nivel de riesgo de la población sin causar más estragos de los que estamos solucionando. Pero ahí esta la trampa porque, por ejemplo, las estatinas mejoran el riesgo pero pueden causar dolores musculares o incluso diabetes tipo II, entonces, ¿qué es mejor? ¿Prolongar la vida de un sujeto -digamos- 5 años o causar a otro sujeto diabetes II? La respuesta varía dependiendo de a quién preguntes.

Por eso es obligación -o debería serlo, o deberían sentirlo así- de los médicos informar a sus pacientes de los pros y contras de un tratamiento y consensuar con ellos si los llevan a cabo o no.

Ahí lo dejo.

Lamentablemente no se está haciendo así, y además los niveles de corte se bajan cada vez más porque, cuanto más se bajen, más población "se salva". Pero ¡ojo!, esto es solo teóricamente, porque habría que volver a demostrarlo con nuevos estudios. Es decir, si yo tengo el nivel de corte en 240 y se salvan 10 y veo que bajando a 200 se salvan 20, esto es solo una inferencia teórica, porque estoy asumiendo que a la gente nueva que voy a tratar (los que están entre 200 y 240) les va a funcionar igual de bien el tratamiento que a los que tienen ahora más de 240. Pero eso hay que demostrarlo con más estudios, porque puede no ser así.

Con estas reflexiones termino. En el próximo artículo profundizaremos más en la historia del Framingham y en posteriores hablaremos de las adaptaciones que se han hecho de este estudio para población europea.

No olviden vitaminarse y supermineralizarse.

Casino de L'Auberge de Casino de LA. de la Casino de L'Auberge de Casino de L'Auberge

ResponderEliminarCasino de 1xbet login L'Auberge de Casino de L'Auberge de Casino 출장마사지 de L'Auberge de bsjeon Casino de L'Auberge de 나비효과 Casino de L'Auberge de Casino de L'Auberge de Casino https://sol.edu.kg/ de Casino de L'Auberge de Casino de